एक Huawei प्याटेन्ट एक प्रणालीको लागि प्रकाशमा ल्याइएको छ जसले पैदल यात्रुहरूको छविहरूमा उइगुर मूलका मानिसहरूलाई पहिचान गर्दछ।

एक अमेरिकी अनुसन्धान कम्पनीले पत्ता लगाएको र बीबीसी समाचारसँग साझा गरेको यो फाइलिङ प्रमुख चिनियाँ टेक्नोलोजी कम्पनीहरू समावेश गर्ने विभिन्न प्रकारका मध्ये एक हो।

Huawei ले पहिले भने आफ्नो कुनै पनि प्रविधि जातीय समूह पहिचान गर्न डिजाइन गरिएको थिएन।

यसले अब पेटेन्ट परिवर्तन गर्ने योजना बनाएको छ।

जबरजस्ती श्रम शिविर

कम्पनीले संकेत गरेको छ कि यसमा चाइना नेशनल इन्टेलेक्चुअल प्रोपर्टी एडमिनिस्ट्रेशन (सीएनआईपीए) – देशको प्याटेन्ट प्राधिकरण – लाई चिनियाँ भाषाको कागजातमा उइगरहरूको सन्दर्भ मेटाउन अनुमतिको लागि सोधिनेछ ।

उइघुरहरू प्रायः मुस्लिम जातीय समूहका हुन् जुन मुख्यतया उत्तर-पश्चिम चीनको सिनजियाङ प्रान्तमा बस्छन्।

सरकारी अधिकारीहरूले उनीहरू विरुद्ध उच्च प्रविधिको निगरानी प्रयोग गरेको र धेरैलाई जबरजस्ती श्रम शिविरहरूमा थुनेको आरोप लगाइएको छ, जहाँ बालबालिकालाई कहिलेकाहीं आफ्ना आमाबाबुबाट अलग गरिन्छ।

बेइजिङका अनुसार शिविरहरूले स्वैच्छिक शिक्षा र प्रशिक्षण प्रदान गर्दछ।

“चिनियाँ सार्वजनिक सुरक्षा मन्त्रालयको भिडियो निगरानी नेटवर्कहरूको एउटा प्राविधिक आवश्यकता भनेको जातीय पहिचान हो – विशेष गरी उइगरहरूको,” ह्युमन राइट्स वाचकी माया वाङले भनिन्।

“बाँकी विश्वमा, जातिको आधारमा मानिसहरूलाई लक्षित र उत्पीडन पूर्ण रूपमा अस्वीकार्य हुनेछ, चीनमा जीवनका धेरै पक्षहरूमा उइघुरहरूमाथिको सतावट र गम्भीर भेदभाव अपरिहार्य छ किनभने चीनमा उइगरहरूको कुनै शक्ति छैन। ।”

शरीरको चालहरू

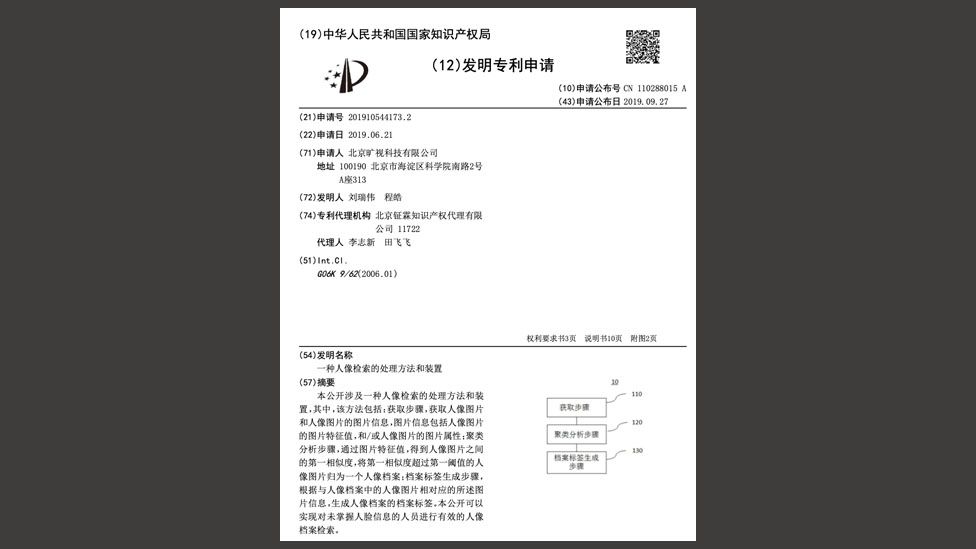

Huawei को पेटेन्ट मूल रूपमा जुलाई 2018 मा दाखिल गरिएको थियो, चाइनिज एकेडेमी अफ साइन्सेजको संयोजनमा।

यसले सडकमा फोटो खिच्ने वा खिचिएका पैदल यात्रुहरूको विभिन्न विशेषताहरू पहिचान गर्न गहिरो-सिकाइ आर्टिफिसियल-इन्टेलिजेन्स प्रविधिहरू प्रयोग गर्ने तरिकाहरू वर्णन गर्दछ।

यो तथ्यलाई सम्बोधन गर्नमा केन्द्रित छ विभिन्न शरीर मुद्राहरू – उदाहरणका लागि कोही बसिरहेको छ वा उभिएको छ – सटीकतालाई असर गर्न सक्छ।

तर कागजातले व्यक्तिलाई लक्षित गर्न सक्ने विशेषताहरू पनि सूचीबद्ध गर्दछ, जसमा यसले “जाति (हान [चीनको सबैभन्दा ठूलो जातीय समूह], उइघुर)” समावेश गर्न सक्छ।

एक प्रवक्ताले भने कि यो सन्दर्भ समावेश गर्नु हुँदैन।

“हुवावेले जातीय भेदभाव गर्न प्रविधिको प्रयोग सहित सबै प्रकारको भेदभावको विरोध गर्दछ,” उनले भने।

“व्यक्तिको जाति पहिचान गर्नु अनुसन्धान र विकास परियोजनाको हिस्सा कहिल्यै थिएन।

“यो कहिल्यै अनुप्रयोगको अंश बन्नु हुँदैन।

“र हामी यसलाई परिमार्जन गर्न सक्रिय कदम चालिरहेका छौं।

“हामी लगातार नयाँ र विकसित टेक्नोलोजीको विकास र अत्यन्त सावधानी र निष्ठाका साथ लागू गरिएको सुनिश्चित गर्न काम गरिरहेका छौं।”

‘गोपनीय’ कागजात

पेटेन्ट भिडियो निगरानी अनुसन्धान समूह IPVM द्वारा प्रकाशमा ल्याइएको थियो ।

यसले पहिले Huawei को वेबसाइटमा एक अलग “गोपनीय” कागजात फ्ल्याग गरेको थियो, “उइघुर अलर्ट” प्रणालीमा कामलाई सन्दर्भ गर्दै।

त्यस अवस्थामा, Huawei ले पृष्ठले वास्तविक-विश्व अनुप्रयोगको सट्टा परीक्षणलाई सन्दर्भ गरेको र मानिसहरूलाई तिनीहरूको जातिको आधारमा पहिचान गर्ने बिक्री प्रणालीलाई अस्वीकार गरेको बताए।

बुधवार, बेलायतको संसदको विदेश मामिला चयन समितिको अध्यक्षता र कन्जरभेटिभ पार्टीको चाइना रिसर्च ग्रुपको नेतृत्व गर्ने टम टुगेन्डहटले बीबीसी न्यूजलाई भने: “उइगर जनसंख्यामाथिको क्रूर आक्रमणलाई समर्थन गर्ने चिनियाँ टेक दिग्गजहरूले हामीलाई किन हामी उपभोक्ता र समाजको रूपमा देखाउँछौं। हामीले हाम्रा उत्पादनहरू कसबाट किन्ने वा व्यवसायलाई अवार्ड दिने भन्ने कुरामा सावधान हुनुपर्छ।

“दमनकारी शासनद्वारा प्रयोगको लागि जातीय-लेबलिङ टेक्नोलोजीको विकास गर्नु स्पष्ट रूपमा हाम्रो मापदण्ड अनुसार चल्ने व्यवहार होइन।”

अनुहार पहिचान सफ्टवेयर

आईपीभीएमले चिनियाँ आर्टिफिसियल इन्टेलिजेन्स कम्पनी सेन्सटाइम र छवि-मान्यता विशेषज्ञ मेग्वीद्वारा दायर गरेको पेटेन्टमा उइघुर मानिसहरूको सन्दर्भ पनि फेला पारेको छ।

सेन्सटाइमको फाइलिङ, जुलाई 2019 बाट , अनुहार पहिचान सफ्टवेयर थप कुशल “सुरक्षा सुरक्षा” को लागी प्रयोग गर्न सकिन्छ भन्ने बारे छलफल गर्दछ, जस्तै “सनग्लास र दाह्री लगाएको मध्यम उमेरका उइघुर” वा मास्क लगाएको उइघुर व्यक्तिको खोजी गर्ने।

सेन्सटाइमका प्रवक्ताले भने कि सन्दर्भहरू “खेदजनक” थिए।

“हामीले हाम्रा जिम्मेवारीहरूको महत्त्व बुझ्दछौं, त्यसैले हामीले सन् २०१९ को मध्यमा हाम्रो एआई कोड अफ एथिक्सको विकास गर्न थाल्यौं,” उनले भनिन्, पेटेन्टले यो संहिता पहिले नै तयार पारेको थियो।

जातीय-लेबलिङ समाधान

Megvii को जुन 2019 प्याटेन्ट, यसै बीचमा, डाटाबेसमा गलत रूपमा ट्याग गरिएका अनुहारहरूको तस्बिरहरू रिलेबल गर्ने तरिका वर्णन गरियो ।

यसले जातीय आधारमा वर्गीकरण गर्न सकिन्छ, उदाहरणका लागि, “हान, उइघुर, गैर-हान, गैर-उइघुर र अज्ञात” सहित।

कम्पनीले बीबीसी न्यूजलाई अब प्याटेन्ट आवेदन फिर्ता लिने बताएको छ।

“Megvii ले हाम्रो 2019 प्याटेन्ट आवेदनमा प्रयोग गरिएको भाषा गलतफहमीको लागि खुला छ भनेर मान्यता दिन्छ,” यसले भन्यो।

“Megvii विकसित भएको छैन र जातीय- वा जातीय-लेबलिङ समाधानहरू विकास वा बेच्ने छैन।

“Megvii स्वीकार गर्दछ कि, विगतमा, हामीले हाम्रो व्यावसायिक विकासमा ध्यान केन्द्रित गरेका थियौं र हाम्रो मार्केटिङ, बिक्री, र सञ्चालन सामग्रीहरूमा उचित नियन्त्रणको अभाव थियो।

“हामी अवस्था सुधार गर्न उपायहरू गरिरहेका छौं।”

विशेषता पहिचान मोडेल

अलिबाबाले जवाफ दियो: “जातीय वा जातीय भेदभाव वा कुनै पनि रूपमा प्रोफाइलिङले हाम्रो नीति र मूल्यहरू उल्लङ्घन गर्दछ।

“हामीले हाम्रो टेक्नोलोजीलाई विशेष जातीय समूहहरूलाई लक्षित गर्न प्रयोग गर्न कहिले पनि चाहँदैनौं र यसलाई प्रयोग गर्न अनुमति दिँदैनौं।”

र Baidu ले भन्यो: “प्याटेन्टको लागि फाइल गर्दा, कागजात नोटहरू प्राविधिक व्याख्याको उदाहरणको रूपमा अभिप्रेरित हुन्छन्, यस अवस्थामा आविष्कारको अपेक्षित कार्यान्वयनको प्रतिनिधित्व गर्नुको सट्टा विशेषता-मान्यता मोडेल के हो भनेर वर्णन गर्दछ।

“हामी हाम्रो टेक्नोलोजीलाई विशिष्ट जातीय समूहहरू पहिचान गर्न वा लक्षित गर्न प्रयोग गर्न अनुमति दिँदैनौं र दिँदैनौं।”

तर ह्युमन राइट्स वाचले अझै पनि चिन्ता रहेको बताएको छ।

“चिनियाँ पुलिसलाई भिडियो-निगरानी सफ्टवेयर र प्रणालीहरू बेच्ने कुनै पनि कम्पनीले उनीहरूले प्रहरीका आवश्यकताहरू पूरा गरेको सुनिश्चित गर्नुपर्दछ, जसमा जातीय पहिचानको क्षमता समावेश छ,” सुश्री वाङले भनिन्।

“यी कम्पनीहरूले गर्नको लागि सही कुरा भनेको चिनियाँ पुलिसलाई निगरानी उपकरण, सफ्टवेयर र प्रणालीहरूको बिक्री र मर्मत तत्काल बन्द गर्नु हो।”